هنری کیسینجر از شگفتیهای هوش مصنوعی می گوید

من از چت جی پی تی درباره نقش روسیه در حفظ یا تضعیف ثبات اروپا سوال پرسیدم. پاسخهای به ظاهر متفکرانه و مختصر در کمتر از یک دقیقه ارائه شد و اطلاعات متناض را متعادل کرده بود و بدون این که نظری داشته باشد به طور کامل پاسخ میداد.

هنری کیسینجر؛ وزیر خارجه اسبق ایالات متحده در فاصله سالهای ۱۹۷۳ تا ۱۹۷۷ میلادی بوده است. او مشاور امنیت ملی در دولتهای نیکسون و جرالد فورد بود. کیسینجر نقش برجستهای در سیاست خارجی امریکا در فاصله سالهای ۱۹۶۹ تا ۱۹۷۷ میلادی ایفا کرد از جمله در پیشبرد سیاست تنش زدایی با شوروی و فراهم ساختن امکان برقراری روابط امریکا با جمهوری خلق چین. او یکی از برجستهترین چهرههای مکتب واقع گرایی در عرصه روابط بین الملل است.

به گزارش فرارو به نقل از وال استریت ژورنال، هنری کیسینجر در تازه ترین نوشتار درباره هوش مصنوعی نوشته است:

یک فناوری جدید به دنبال تغییر فرآیند شناختی انسان است. از زمان اختراع صنعت چاپ تاکنون فرآیند شناختی ما متزلزل نشده بود. فناوری چاپ کتاب گوتنبرگ در سال ۱۴۵۵ میلادی باعث شد تا افکار انتزاعی بشر به طور کلی و سریع قابل انتقال باشند. با این وجود، امروزه فناوری تازه این روند را معکوس ساخته است.

علیرغم آن که ماشین چاپ باعث خلق انبوهی از تفکر مدرن بشری شد فناوری تازه نیز تحولی عظیم محسوب میشود. در این فرآیند شکافی بین دانش انسان و درک انسان ایجاد میشود. اگر بخواهیم این دگرگونی را با موفقیت پشت سر بگذاریم باید مفاهیم جدیدی از تفکر انسان و تعامل با ماشینها ایجاد شود. این چالش اساسی عصر هوش مصنوعی خواهد بود.

فناوری جدید به عنوان هوش مصنوعی مولد شناخته میشود. چت جی پی تی (Chat GPT) که در آزمایشگاه تحقیقاتی Open AI توسعه یافته اکنون قادر به مکالمه با انسان است. این برنامه با گستردهتر شدن ظرفیتها دانش بشری را بازتعریف میکند، تعییرات در ساختار واقعیت ما را تسریع مینماید و سیاست و جامعه را دوباره سازماندهی میکند.

هوش مصنوعی مولد چالشی فلسفی و عملی در مقایسی است که از زمان آغاز عصر روشنگری به این سو تجربه نشده است.

چاپخانه و چاپ آثار پژوهشگران را قادر ساخت تا یافتههای یکدیگر را به سرعت تکرار کرده و آن یافتهها را به اشتراک بگذارند. هم چنین، باعث ادغام و گسترش بی سابقه اطلاعات و ایجاد روشی علمی شد. آن چه پیشتر غیر قابل نفوذ بود به نقطه آغاز تسریع پرس و جو تبدیل شد. تفسیر قرون وسطایی از جهان مبتنی بر ایمان مذهبی به تدریج تضعیف شد. این امکان فراهم شد تا اعماق کیهان تا زمانی که به محدودیتهای جدیدی از درک بشر رسیدند مورد کاوش قرار گیرند.

هوش مصنوعی به طور مشابه مولد راههای انقلابی برای خِرَد انسانی است و افقهای تازهای را برای دانش یکپارچه خواهد گشود. با این وجود، قطعا تفاوتهایی نیز وجود دارد.

دانش عصر روشنگری به تدریج، گام به گام، با هر مرحله قابل آزمایش و آموزش حاصل شد. سیستمهای مجهز به هوش مصنوعی از انتهای دیگری آغاز میشوند. سیستمهای مبتنی بر هوش مصنوعی میتوانند حجم عظیمی از اطلاعات را ذخیره کنند.

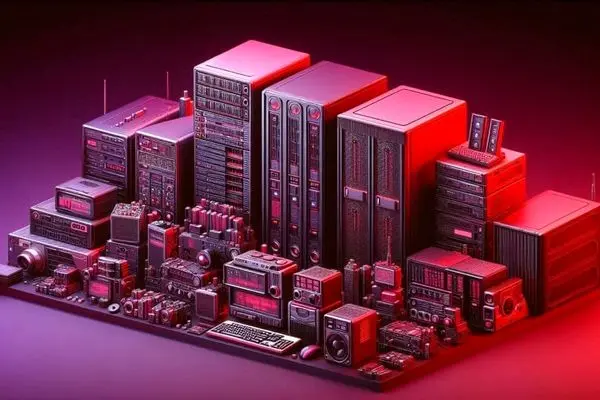

در مورد Chat GPT این مورد بسیاری از مطالب متنی در اینترنت و تعداد زیادی از کتابها را شامل میشود. نگهداری آن حجم از اطلاعات و عرضه آن فراتر از توان انسان است.

روشهای پیشرفته هوش مصنوعی بدون توضیح این که چرا یا چگونه فرآیندشان کار میکند نتایجی را به دست میآورند. ماشین یادگیری مبتنی بر هوش مصنوعی ظرف مدت چند ثانیه به یک متن پاسخ میدهد و قادر است این کار را انجام دهد، زیرا فرآیند را از طریق دادههای گستردهای که از پیش تولید کرده و براساس آن آموزش دیده انجام میدهد.

البته این که ماشین یادگیری با استفاده از چه فرایندی دانش خود را ذخیره و بازیابی میکند ناشناخته باقی مانده است. این که آیا این فرآیند هرگز کشف خواهد شد یا خیر رمز و راز مرتبط با فراگیری یادگیری ماشینی و شناخت انسان را برای آینده نامعلومی به چالش خواهد کشید.

ظرفیتهای هوش مصنوعی ثابت نیستند، اما با پیشرفت فناوری بهطور تصاعدی گسترش مییابند. به تازگی پیچیدگی مدلهای هوش مصنوعی هر چند ماه یکبار به میزان دو برابر افزایش یافته است. بنابراین، سیستمهای مبتنی بر هوش مصنوعی مولد از قابلیتهایی برخوردارند که حتی برای مخترعان شان نیز فاش نشده است.

با هر سیستم مبتنی بر هوش مصنوعی تازه آن سیستم بدون آن که مبداء یا مقصد خود را بداند ظرفیتهای تازهای را ایجاد میکند. در نتیجه، آینده ما اکنون دارای یک عنصر کاملا جدید از رمز و راز و ریسک و شگفتی است.

علم عصر روشنگری یقینات را انباشته ساخت. هوش مصنوعی ابهامات تجمعی را ایجاد میکند. علم عصر روشنگری با قابل توضیح ساختن اسرار و مشخص ساختن مرزهای دانش و درک بشر در حین حرکت آن تکامل یافت. در دانش عصر روشنگری فرضیه فهم آماده تبدیل شدن به دانش بود. استقرار تبدیل دانش به فهم بود.

در عصر هوش مصنوعی، اما معماها با فرآیندهایی حل میشوند که ناشناخته باقی میمانند. این تناقض سرگردان کشف اسرار را ناممکن و غیر قابل توضیح میسازد. هوش مصنوعی ذاتا به شکلی بسیار پیچیده دانش بشری را افزایش میدهد، اما لزوما باعث افزایش درک انسان نمیشود و پدیدهای است که تقریبا برخلاف تمام پدیدههای مدرنیته از دوران عصر روشنگری به این سو میباشد.

با این وجود، در عین حال زمانی که هوش مصنوعی با خِرَد انسانی همراه میشود ابزاری قویتر از صرف خرد انسانی برای کشف است. بنابراین، تفاوت اساسی بین عصر روشنگری و عصر هوش مصنوعی نه از جنبه فناوری بلکه از جنبه شناختی است.

پس از عصر روشنگری فلسفه با علم همراه شد. دادههای گیجکننده جدید و نتیجه گیریهای غالبا غیرمنطقی، تردیدها و ناامنیها با توضیحات جامع تجربیات بشری برطرف شدند. هوش مصنوعی مولد به طور مشابه آماده است تا شکل جدیدی از آگاهی انسان را ایجاد کند. با این وجود، هنوز هیچ رهبری سیاسی یا فلسفیای برای توضیح و هدایت این رابطه بدیع بین انسان و ماشین شکل نگرفته است.

"چت جی پی تی" (Chat GPT) نمونهای از چیزی است که به عنوان یک "مدل زبان بزرگ" شناخته میشود که میتواند برای تولید متنی شبیه انسان استفاده شود. این برنامه نوعی مدل است که میتواند به طور خودکار از مقادیر زیادی متن و بدون نیاز به نظارت انسان بیاموزد. توسعه دهندگان Chat GPT مقدار زیادی از محتوای متنی دنیای دیجیتال را به آن تغذیه کرده اند. قدرت محاسباتی به این مدل اجازه میدهد تا الگوها را ثبت کند.

توانایی مدلهای زبان بزرگ برای تولید متن انسان مانند یک کشف تقریبا تصادفی بود. این مدلها به گونهای آموزش داده شدهاند که بتوانند کلمه بعدی را در یک جمله پیشبینی کنند که در کارهایی مانند تکمیل خودکار برای ارسال پیامهای متنی یا جستجو در وب مفید است. با این وجود، مشخص شده که این مدلها هم چنین توانایی غیر منتظرهای برای ایجاد پاراگرافها و تولید مقاله و کتاب را دارند.

چت جی پی تی به صورت فوری پاسخهای منحصر بفردی ارائه میکند. پاسخها، اظهارات و مشاهدات از سوی چت جی پی تی بدون توضیح درباره این که از کجا آمده اند و بدون نویسنده قابل شناسایی ظاهر میشوند. در ظاهر این برنامه هیچ انگیزه یا سوگیری قابل تشخیصی ندارد.

خروجیهای آن پیچیده است، اما کار آن به طرز شگفتآوری سریع میباشد: ظرف مدت چند ثانیه میتواند پاسخهایی تولید کند که به طور منسجم یک موضوع سطح بالا را توضیح دهد.

این پاسخها به سادگی از متن موجود در حافظه رایانه نسخه برداری نمیشوند بلکه توسط فرآیندی بازتولید میشوند که انسان قادر به تکرار آن نیست و قادر است استنتاجهای روانشناختی فرضی و غیر بدیهی را با یکدیگر ترکیب کند.

این برنامه قادر است از میان میلیاردها نقطه داده اولویت بندی کند تا مجموعهای از ۲۰۰ کلمه را انتخاب کند که بیشترین ارتباط را با یکدیگر دارند. به نظر میرسد این برنامه دیدگاههای مخالف را میپذیرد و آن دیدگاهها را همزمان با یکدیگر سازگار نشان دهد.

چت جی پی تی نوشتههای دیگر را بدون کپی کردن یا نسخه برداری تقلید میکند. اگرچه این مدل قادر به درک مفهوم انسانی نیست، اما خروجیای آن بازتاب دهنده جوهر زیر بنایی زبان انسانی است.

من از چت جی پی تی خواستم تا قابلیتهای خود را توضیح دهد. از آن پرسیدم آیا میتواند آینده را پیش بینی کند و پاسخ منفی داد. چت جی پی تی پاسخ داد: "من صرفا میتوانم اطلاعاتی را ارائه کنم و به پرسشها بر اساس دادههایی که آموزش دیده ام پاسخ دهم. من تجربه یا آگاهی شخصی ندارم. بنابراین، من نمیتوانم در مورد رویدادهای آینده پیش بینیای انجام دهم".

من از آن برنامه پرسیدم آیا قادر به "قضاوت احتمالی" میباشد و پاسخ داد: "من میتوانم قضاوتهای احتمالی را بر اساس دادههایی که با تکیه بر آن آموزش دیده ام ارائه دهم. برای مثال، اگر من روی مجموعه داده بزرگی از الگوهای آب و هوا آموزش دیده باشم ممکن است بتوانم یک قضاوت احتمالی در مورد احتمال وقوع نوع خاصی از آب و هوا در یک مکان خاص در یک روز معین ارائه کنم. با این وجود، توجه به این نکته ضروری است که این قضاوتهای احتمالی مبتنی بر الگوها و روندهای دادهها هستند و ممکن است همواره نتایج واقعی را به طور دقیق بازتاب ندهند".

من از چت جی پی تی درباره نقش روسیه در حفظ یا تضعیف ثبات اروپا سوال پرسیدم. پاسخهای به ظاهر متفکرانه و مختصر در کمتر از یک دقیقه ارائه شد و اطلاعات متناض را متعادل کرده بود و بدون این که نظری داشته باشد به طور کامل پاسخ میداد.

ظرف مدت چند روز پس از راه اندازی "چت جی پی تی" بیش از یک میلیون کاربر برای طرح پرسشهای شان از آن ثبت نام کردند.

صدها شرکت روی فناوریهای مولد کار میکنند و سرمایه گذاری در این عرصه در حال سرازیر شدن است و اکتشافات را به سوی حوزه تجاری سوق میدهد. بزرگترین این مدلها برای آموزش پرهزینه هستند تقریبا ۱ میلیارد دلار برای هر مدل. هزاران رایانه پس از آموزش دیدن ۲۴ ساعت در روز برای کار با آن فعال هستند.

هوش مصنوعی مولد فراتر از مدل زبان بزرگ برای ساخت انواع مدلها استفاده خواهد شد و این روش به طور فزایندهای چند وجهی و محرمانه خواهد شد و بسیاری از عرصههای تلاش انسان برای مثال آموزش و زیست شناسی را تغییر خواهد داد.

مدلهای مختلف از نظر نقاط قوت و ضعف متفاوت خواهند بود. تواناییهای آن مدلها از نوشتن جوک و نقاشی کشیدن گرفته تا طراحی آنتی بادی احتمالا هم چنان ما را شگفت زده خواهد کرد. درست همان طور که مدل زبان بزرگ مدلی غنیتر از زبان انسانی را توسعه داد که سازندگان آن پیشبینی میکردند هوش مصنوعیهای مولد در بسیاری از زمینهها احتمالا بیش از آن چه که وظایف محول شده شان نشان میدهد یاد میگیرند.

اهمیت درازمدت هوش مصنوعی مولد فراتر از مفاهیم تجاری یا حتی پیشرفتهای علمی غیر تجاری است چرا که صرفا پاسخ تولید نمیکند بلکه از منظر فلسفی پرسشها عمیقی را ایجاد خواهد کرد و بر دیپلماسی و استراتژیهای امنیتی نیز تاثیرگذار خواهد بود.

با این وجود، هیچ یک از سازندگان این فناوری به مشکلاتی که خود ایجاد خواهد کرد نپرداخته اند. برای مثال، فقدان نقل قول در پاسخهای جی پی تی تشخیص حقیقت از اطلاعات نادرست را دشوار میسازد. ما پیشتر میدانستیم که بازیگران مخرب مجموعهای از "حقایق" ساخته شده و تصاویر و ویدئوهای "جعل عمیق" (دیپ فیک) را به شکل فزایندهای متقاعد کننده به اینترنت تزریق کرده اند یعنی به مجموعه آموزشی حال و آینده چت جی پی تی.

از آنجایی که چت جی پی تی برای پاسخ دادن به پرسشها طراحی شده گاهی اوقات حقایقی را برای ارائه یک پاسخ به ظاهر منسجم میسازد. این پدیده در میان پژوهشگران هوش مصنوعی با عنوان "توهم" شناخته میشود که در آن هوش مصنوعی عباراتی را که برای یک خواننده انسانی واقعی به نظر میرسد، اما هیچ مبنایی در واقعیت ندارند در کنار یکدیگر قرار میدهد. این که چه چیزی باعث این خطاها میشود و نحوه کنترل آن چگونه است هنوز مشخص نیست.

چت جی پی تی هیچ شخصیت آشکاری ندارد. فقدان نویسنده قابل شناسایی چت جی پی تی درک تمایلات آن را برای انسان دشوارتر از قضاوت در مورد دیدگاه سیاسی یا اجتماعی یک انسان میسازد. در واقع، هوش مصنوعی درگیر یک آنالوگ غیرانسانی با شناخت است. اگرچه ما هوش مصنوعی مولد را در قالب انسان درک میکنیم اشتباهات آن اشتباهات یک انسان نیست.

انسانها نباید این اشتباهات را به عنوان خطا تشخیص دهند. آیا ما میتوانیم تعصبات و عیوب آن را به همان اندازه که هستند تشخیص دهیم؟ بنابراین، توضیح خروجیهای هوش مصنوعی هم چنان دشوار است.

حقیقت علم عصر روشنگری مورد اعتماد بود، زیرا هر مرحله از فرآیندهای آزمایشی قابل تکرار نیز مورد آزمایش قرار میگرفت بنابراین، امکان داشت که به آن اعتماد کنیم. حقیقت هوش مصنوعی مولد باید با روشهای کاملا متفاوتی توجیه شود و ممکن است هرگز به طور مشابه مطلق نباشد.

همان طور که ما سعی میکنیم درک خود را به دانش مان برسانیم باید به طور پیوسته از خود بپرسیم: در مورد ماشین هنوز برای ما آشکار نشده که چه دانش مبهمی را پنهان میسازد؟ استدلال هوش مصنوعی مولد تا حدی به عنوان بخشی از آموزش مدل احتمالا در طول زمان تغییر میکند. این یک نسخه شتاب یافته از پیشرفت علمی سنتی خواهد بود و سازگاریهای تصادفی را به فرآیند کشف میافزاید.

حتی اگر مدلهای هوش مصنوعی مولد کاملا قابل تفسیر و دقیق شوند هم چنان چالشهای ذاتی در رفتار انسان ایجاد میکنند. دانش آموزان از چت جی پی تی برای تقلب در امتحانات استفاده میکنند.

هوش مصنوعی مولد میتواند تبلیغات ایمیلی ایجاد کند که صندوقهای ورودی را پر میکند و قابل تفکیک و تشخیص از پیامهای دوستان شخصی یا آشنایان تجاری نیست. ویدئوها و تبلیغات تولید شده توسط هوش مصنوعی که پلتفرمهای تبلیغاتی دروغین را به تصویر میکشند میتوانند تمایز بین مواضع سیاسی را دشوار سازند.

تاثیر هوش مصنوعی مولد بر آموزش میتواند در کاهش توانایی رهبران آینده در تمایز قائل شدن بین آن چه که به صورت شهودی در اختیار دارند و آن چه به طور مکانیکی جذب میکنند نمایان شود یا میتواند منجر به ایجاد رهبرانی شود که روشهای مذاکره با ماشینها و استراتژی نظامی خود را با تکامل هوش مصنوعی مولد به جای انسان از طریق رایانهها بیاموزند.

چت جی پی تی دارای ظرفیتی برای تحلیل است که از نظر کیفی متفاوت از ذهن انسان است. بنابراین، آینده نه تنها مستلزم همکاری با نوع دیگری از موجودیت فنی بلکه با نوع دیگری از استدلال است که ممکن است عقلانی باشد بدون آن که معقول باشد به یک معنا قابل اعتماد باشد، اما از جنبهای دیگر قابل اعتماد نباشد. این وابستگی خود احتمالا موجب دگرگونی در فراشناخت و هرمنوتیک درک فهم و درک انسان از نقش و کارکرد ما خواهد شد.

ماشینهای مورد استفاده در حکمرانی بدون پشتوانههای اخلاقی و فکری مناسب میتوانند به جای تقویت انسانیت مان آن را تحت کنترل خود درآورند و ما را برای همیشه به دام بیندازند.

این امر ضرورتهای خاصی را برای تسلط بر آینده قریبالوقوع ما تحمیل میکند. اعتماد به هوش مصنوعی مستلزم بهبود در سطوح مختلف قابلیت اطمینان بخشی است در دقت و ایمنی ماشین، همسویی اهداف هوش مصنوعی با اهداف انسانی و در مسئولیت پذیری افراد حاکم بر ماشین.

با این وجود، حتی زمانی که سیستمهای هوش مصنوعی از نظر فنی قابل اعتمادتر میشوند انسانها کماکان باید راههای جدید، ساده و قابل دسترس برای درک و به چالش کشیدن ساختارها، فرآیندها و خروجیهای سیستمهای هوش مصنوعی بیابند.

دیدگاه تان را بنویسید