احتمال وقوع فاجعهای مشابه چرنوبیل در عرصه هوش مصنوعی

یک محقق رایانه هشدار میدهد که اگر در مورد هوش مصنوعی اقدامات امنیتی انجام نشود وضعیتی مشابه فاجعهی چرنوبیل رخ خواهد داد.

گسترش هوش مصنوعی در عرصهی فناوری جالب اما در عین حال ترسناک است.

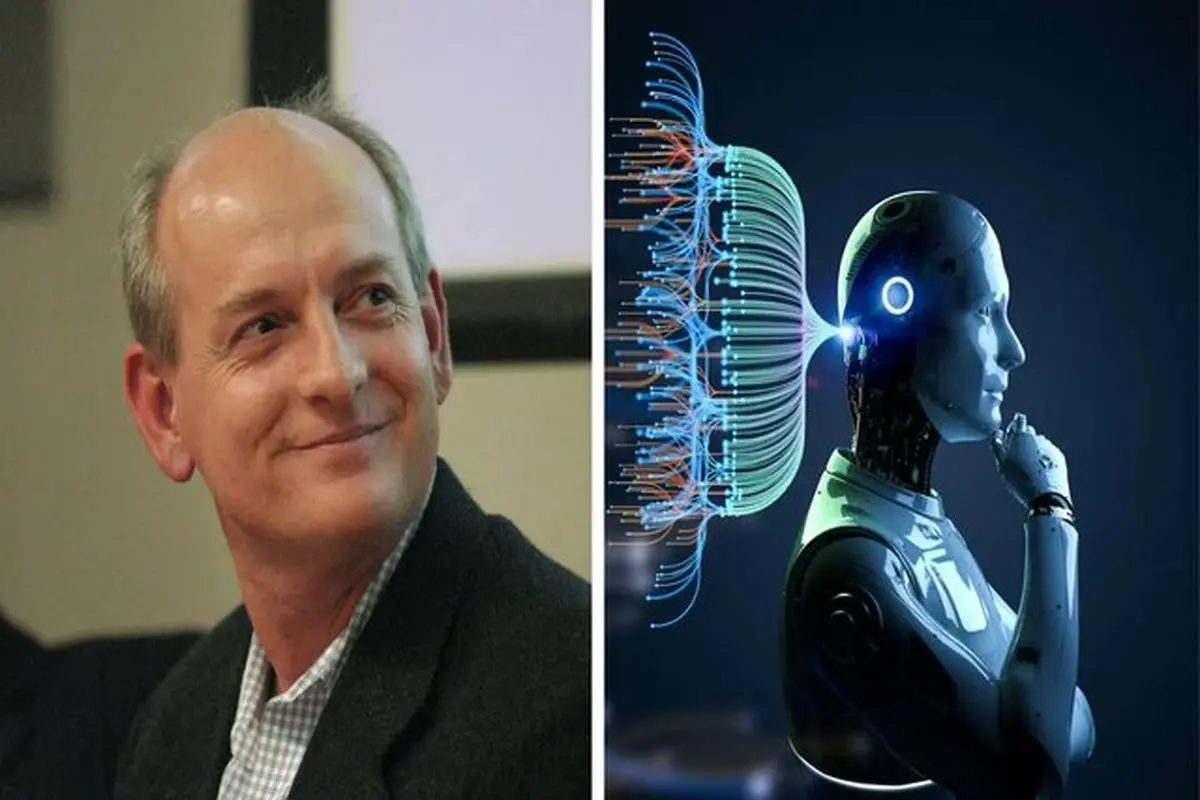

به گزارش ایسنا بهنقل از ای آی، استوارت راسل(Stuart Russell)، دانشمند مشهور رایانه در دانشگاه برکلی، نسبت به عواقب ناگوار این فناوری در صورت عدم کنترل توسعه هوش مصنوعی هشدار داده است. راسل یکی از دانشمندان برجستهای است که نامهای را امضا کرد که به دنبال توقف گسترش محصولات مبتنی بر هوش مصنوعی طی شش ماه آینده بود.

باور اینکه هوش مصنوعی چت جیپیتی(ChatGPT) تنها چند ماه است که وارد زندگی ما شده، سخت است. در حالی که هوش مصنوعی در گذشته موضوع بحث در میان گروه کوچکی از محققان رایانه بود، چتباتها امروزه به موضوع اصلی بحث و گفتگو در رسانهها تبدیل شدهاند. آنها با طیف وسیعی از محصولات مورد استفاده در زندگی روزمره، از برنامههای کاربردی رایانهای گرفته تا حتی مراقبتهای بهداشتی مرتبط هستند.

یک ابزار همه کاره میتواند کاربردهای بیشماری داشته باشد که بهرهوری کارمندان را افزایش داده و زندگی را برای بسیاری آسانتر کند. با این حال، جنبه تاریکتری نیز وجود دارد و آن ترس از دست دادن شغل و انتشار محتوای نادرست است. برخی از کارشناسان هوش مصنوعی هشدار دادهاند که ضرر این فناوری بسیار بیشتر از دستاوردهایی است که میتوان با استفاده از آن به دست آورد، بنابراین، ما باید توسعه آن را متوقف کنیم.

یک چرنوبیل برای هوش مصنوعی

راسل، استاد علوم رایانه و یکی از متخصصان برجسته در زمینهی هوش مصنوعی و یادگیری ماشینی است و متن «هوش مصنوعی: رویکردی مدرن» را که یکی از معتبرترین متون امروزی در زمینه هوش مصنوعی است، نوشته است.

راسل در گفتگو با رسانهی «Business Today»، بر نیاز به اعمال دستورالعملهای معقول و اقدامات ایمنی برای تضمین توسعه ایمن این فناوری تاکید کرده است. راسل که به مدت ۴۵ سال در این زمینه فعالیت کرده میداند که تدوین دستورالعمل برای هوش مصنوعی زمانبر است، اما اگر میخواهیم فناوری هوش مصنوعی آینده عواقب فاجعهباری نداشته باشد، الزامی است.

او توسعه فناوری هوش مصنوعی را به ساخت نیروگاه هستهای تشبیه کرده و گفته است، درست همانطور که باید نشان داد یک نیروگاه هستهای میتواند در برابر زلزله مقاومت کند و مکانیسمهای ایمنی در آن وجود دارد، دستورالعملهای معقول نیز تضمین میکنند که فناوری هوش مصنوعی که به سرعت در حال توسعه است منجر به ایجاد «چرنوبیل در دنیای هوش مصنوعی» نمیشود.

راسل حتی با وجود تجربه بینظیر خود، پیشبینی دقیق رویدادی مشابه چرنوبیل در عرصهی هوش مصنوعی را چالش برانگیز میدانست، اما خواستار احتیاط در هنگام توسعه محصولات جدید بود. این استاد دانشگاه کالیفرنیا برکلی همچنین افزود که عقل سلیم میگوید هنگام توسعه سیستمهای هوش مصنوعی جدید باید تضمین کرد که این سیستمها جامعه را تهدید نمیکنند.

دیدگاه تان را بنویسید